📄Une explosion de contenu… mais à quel prix ?

L’intelligence artificielle générative vit son âge d’or. Elle permet à quiconque, sans effort apparent, de produire en quelques secondes des textes, des images, des scripts ou encore des vidéos. Cette révolution technologique bouleverse les usages, de la communication à l’éducation, du marketing à l’édition.

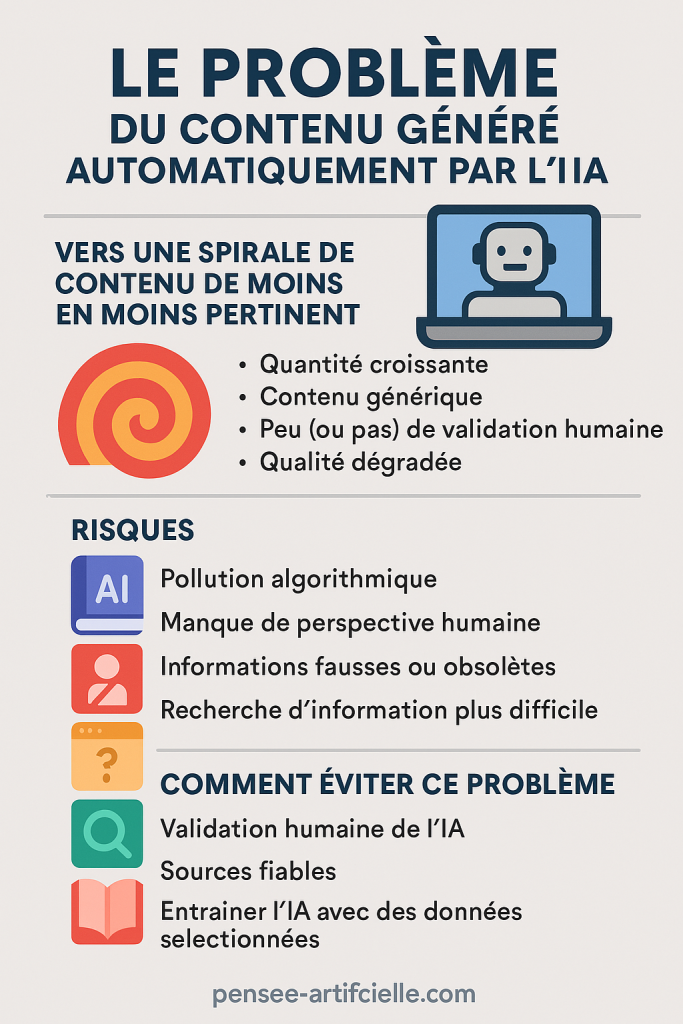

Mais derrière cette innovation se cache un danger silencieux mais réel : celui de la saturation d’Internet par des contenus automatiquement générés sans intervention humaine réelle, sans réflexion, sans recul. Et cette tendance s’accélère.

Selon plusieurs estimations, plus de 60 % des contenus web pourraient être générés par IA d’ici quelques mois, voire plus de 80 % d’ici 2026. Articles de blog, posts LinkedIn, newsletters, descriptions produits, podcasts textuels… tout y passe. Le problème ? Ce flot de données automatisées finit par devenir la source principale d’entraînement des prochaines IA. Et c’est là que le bât blesse.

🤖L’effet boucle : quand l’IA s’alimente de l’IA

Les IA génératives de texte, comme GPT ou Claude, apprennent à partir d’énormes volumes de texte. À l’origine, ces textes provenaient de sources humaines : articles de presse, forums, livres, scripts, etc.

Mais aujourd’hui, une part croissante de leur “alimentation” vient de contenus déjà générés par d’autres IA. Or ces contenus sont souvent superficiels, redondants, voire approximatifs. Résultat : les IA apprennent sur des données qui n’ont jamais été validées par des humains compétents, perdant peu à peu en pertinence, en profondeur, en style.

C’est ce qu’on appelle l’effet miroir ou “pollution algorithmique” : l’IA produit des textes qui nourrissent d’autres IA… qui reproduisent les mêmes biais, approximations, erreurs de fond, voire fausses informations. Une spirale descendante qui menace la qualité globale de l’information sur Internet.

📊Un futur proche : des contenus lisses, fades, interchangeables

À ce rythme, l’internaute lambda sera confronté à une avalanche de contenus :

- Génériques

- Dépersonnalisés

- Privés de toute perspective humaine originale

- Parfois faux ou obsolètes, mais difficiles à vérifier

Et les moteurs de recherche eux-mêmes auront de plus en plus de mal à distinguer le contenu pertinent du bruit généré. Une information sur 5 pourrait devenir erronée ou artificielle d’ici 2030 si cette tendance se poursuit.

✨Comment éviter cette dystopie cognitive ?

Heureusement, il existe des leviers pour éviter cette dérive :

1. 🧠 Remettre l’humain au centre

Les outils d’IA doivent rester des assistants, pas des auteurs finaux. Il est crucial d’impliquer la validation humaine dans chaque production : éditer, reformuler, compléter avec sa propre expertise.

2. 📚 Favoriser les sources vérifiées

Utiliser systématiquement des données vérifiées, des bases scientifiques, des articles reconnus dans les prompts ou en complément. L’IA ne remplace pas l’expert, elle l’aide à structurer ses idées.

3. 🔍 Entraîner les IA sur des corpus sélectionnés

Certaines entreprises et chercheurs travaillent sur des modèles nourris uniquement avec des contenus validés humainement, comme des revues académiques, ou des articles journalistiques de qualité.

4. 📈 Créer moins, mais mieux

Plutôt que de publier massivement du contenu automatisé pour “nourrir l’algorithme”, mieux vaut privilégier la valeur ajoutée réelle. L’originalité, le point de vue, la nuance sont désormais des différenciateurs précieux.

📌Où trouver les “bonnes” données pour entraîner ou valider une IA ?

Voici quelques pistes concrètes :

- 📖 Bases scientifiques ouvertes : arXiv, PubMed, HAL

- 📰 Presse de référence : Le Monde, Reuters, The Guardian (en version archivées ou API)

- 🎓 Données institutionnelles : INSEE, Eurostat, ONU, World Bank

- 📘 Ouvrages de fond : Open Library, Project Gutenberg

- 🧩 Contenus produits par des experts humains : blogs spécialisés, podcasts d’experts, conférences

💡Conclusion : la vraie IA utile est celle qu’on guide

L’intelligence artificielle ne doit pas devenir une machine à recycler du bruit. Elle doit rester un outil d’aide à la réflexion humaine. Plus que jamais, l’intelligence humaine est nécessaire pour donner du sens à l’intelligence artificielle.

La surutilisation de l’IA générative sans réflexion mène à une impasse. C’est à nous de construire un futur où technologie et conscience se renforcent mutuellement, et non l’inverse.

Leave a Comment